Présentation de Cloudera Data Platform (CDP)

19 juil. 2021

Ne ratez pas nos articles sur l'open source, le big data et les systèmes distribués, fréquence faible d’un email tous les deux mois.

Cloudera Data Platform (CDP) est une plateforme de cloud computing pour les entreprises. CDP fournit des outils intégrés et multifonctionnels en libre-service afin d’analyser et de centraliser les données. Elle apporte sécurité et gouvernance à l’échelle de l’entreprise, tout pouvant être déployé en cloud public, privé et multi-cloud. CDP est le successeur des deux précédentes distributions Hadoop de Cloudera : Cloudera Distribution of Hadoop (CDH) et Hortonworks Data Platform (HDP). Dans cet article, nous nous penchons sur la nouvelle offre Big Data de Cloudera et sur ce qui la différencie de ses prédécesseurs.

Vue d’ensemble

CDP propose une approche publique-privée unique, des analyses de données en temps réel, des options de déploiement évolutives on-premise, sur le cloud et en déploiement hybride, ainsi qu’une architecture privilégiant la confidentialité. Selon son site officiel, CDP permet de :

- Générer automatiquement des charges de travail (workload) lorsque cela est nécessaire et suspendre leur fonctionnement lorsqu’elles sont terminées, ce qui permet de contrôler les coûts du cloud

- Utiliser la Data Analysis (l’analyse des données) et le Machine Learning pour optimiser les charges de travail

- Afficher le data lineage de tous les clusters clouds et transitoires

- Utiliser un single pane of glass (panneau de verre unique) à travers les clouds hybrides et multi-clouds

- Évoluer vers des pétaoctets de données et des milliers d’utilisateurs divers

- Utiliser des environnements multi-cloud et hybrides pour centraliser le contrôle des données clients et opérationnelles

CDP est disponible en deux éditions : CDP Public Cloud et CDP Private Cloud.

CDP Public Cloud

CDP Public Cloud est un Platform-as-a-Service (PaaS) qui est compatible avec une infrastructure cloud et transférable sans difficulté entre divers fournisseurs cloud, y compris des solutions privées telles que OpenShift. CDP a été conçue pour être totalement hybride et multi-cloud, ce qui signifie qu’une seule plateforme peut gérer tous les cas d’utilisation du cycle de vie des données, quel que soit le lieu ou le cloud, avec un modèle de sécurité et de gouvernance cohérent. La plateforme CDP peut travailler avec des données avec une multitude de paramètres, y compris des clouds publics tels que AWS, Azure, et GCP. En outre, elle peut faire évoluer automatiquement les charges de travail et les ressources vers le haut ou vers le bas afin d’améliorer les performances et de réduire les coûts.

Services de CDP Public Cloud

Voici les principaux éléments qui composent CDP Public Cloud :

-

Data Engineering

CDP Data Engineering est une boîte à outils de Data Engineering tout-en-un. Construit sur Apache Spark, elle permet de rationaliser les processus ETL à travers les équipes de Data Analysis de l’entreprise en permettant l’orchestration et l’automatisation avec Apache Airflow, et fournit des outils très développés de surveillance des pipelines, de débogage visuel et de gestion. Il dispose d’environnements de travail isolés et est conteneurisé, évolutif et facile à transporter. -

Data Hub

CDP Data Hub est un service qui permet des analyses à haute valeur ajoutée, du Edge à l’IA. Streaming, ETL, datamarts, bases de données et Machine Learning ne sont que quelques-unes des tâches couvertes parmi le large éventail de charges de travail analytiques. -

Data Warehouse

CDP Data Warehouse est un service qui permet à l’IT d’offrir une expérience analytique en libre-service du cloud-native aux analystes BI. Le streaming, le Data Engineering et les analyses Machine Learning (ML) sont tous complètement intégrés dans CDP Data Warehouse. Il dispose d’un framework unifié qui permet de sécuriser et de gouverner toutes vos données et métadonnées sur des clouds privés, publics multiples ou hybrides.

-

Machine Learning

CDP Machine Learning optimise les workflows ML en utilisant des outils natifs et complets pour déployer, distribuer et surveiller les modèles. Avec Cloudera Shared Data Experience (SDX) pour les modèles, il régule et automatise la catégorisation des modèles, puis transfère facilement les résultats pour collaborer via les expériences CDP telles que Data Warehouse et Operational Database.

-

Data Visualization

Avec Cloudera Data Visualization, les utilisateurs peuvent modéliser les données dans le data warehouse virtuel sans avoir à supprimer ou à mettre à jour les structures de données ou les tables sous-jacentes, et interroger de grandes quantités de données sans avoir à charger constamment les données, ce qui permet un gain de temps et d’argent.

-

Operational Database

Cloudera Operational Database est une solution managée qui synthétise l’instance de cluster sous-jacente sous la forme d’une base de données. Elle évoluera automatiquement en fonction de l’utilisation de la charge de travail du cluster et sera capable d’améliorer les performances dans la même empreinte d’infrastructure et de résoudre automatiquement les problèmes opérationnels.

Architecture

Cette section présente l’ensemble des services disponibles dans CDP Public Cloud. Les composants présentés ici peuvent être utilisés indépendamment ou dans leur ensemble.

- Data Hub

- Management Console : service utilisé par les administrateurs CDP pour gérer les environnements, les utilisateurs et les services

- Data Warehouse

- Database Catalogs : une collection logique de définitions de métadonnées pour les données gérées, ainsi que le contexte de données qui va avec

- Virtual Warehouses : une instance de ressources informatiques qui équivaut à un cluster

- Machine Learning : mobiliser les espaces de travail pour le Machine Learning

- Data Engineering (CDE est actuellement disponible uniquement sur Amazon AWS)

- Environment : un sous-ensemble logique de votre compte de fournisseur de services clouds qui comprend un réseau virtuel particulier

- CDE Service : le cluster longue durée Kubernetes et les services qui gèrent les clusters virtuels

- Virtual Cluster : un cluster individuel auto-extensible avec ses propres plages de CPU et de mémoire

- Job : le code de l’application, ainsi que les configurations et ressources spécifiées

- Resource : un ensemble défini de fichiers qui sont nécessaires pour un job

- Securité et gouvernance

- Data Catalog : comprendre, gérer, sécuriser et gouverner les ressources de données

- WorkLoad Manager : offre des informations pour vous aider à mieux comprendre les charges de travail (workload) que vous envoyez aux clusters gérés par Cloudera Manager

- Replication Manager : service pour copier et migrer les données des clusters CDH vers CDP Public Cloud

- Replication HDFS

- Réplication des métadonnées de Hive

- Réplication des tables externes de Hive

- Réplication au niveau des tables

CDP Private Cloud

CDP Private Cloud est conçu pour le déploiement de clouds hybrides, permettant aux environnements on-premises de se connecter aux clouds publics tout en maintenant une sécurité et une gouvernance cohérentes et intégrées. Le traitement et le stockage sont découplés dans CDP Private Cloud, ce qui permet aux clusters de ces deux éléments d’évoluer indépendamment. Disponible sur un cluster CDP Private Cloud Base, Cloudera Shared Data Experience (SDX) offre une sécurité unifiée, une gouvernance, mais aussi une gestion des métadonnées. Les utilisateurs de CDP Private Cloud peuvent approvisionner et déployer rapidement les services Cloudera Data Warehousing et Cloudera Machine Learning, mais aussi les faire évoluer en fonction des besoins, à l’aide de Management Console.

Services de CDP Private Cloud

Certains des composants de CDP Public Cloud, tels que Machine Learning et Data Warehouse, sont disponibles sur CDP Private Cloud. En outre, il utilise une collection de moteurs analytiques couvrant le streaming, la Data Engineering, les datamarts, les operational databases (bases de données opérationnelles) et la Data Science, afin de prendre en charge les charges de travail traditionnelles.

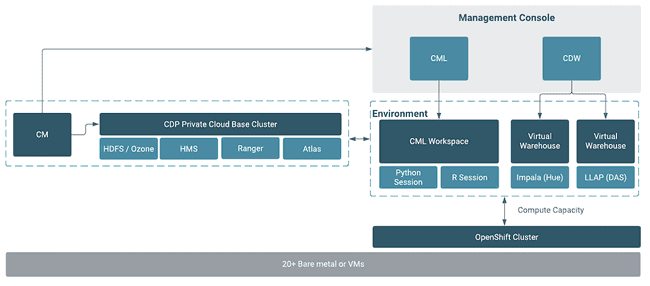

Architecture

Dans cette section, nous présentons divers services et composants disponibles avec CDP Private Cloud. Contrairement à l’offre de Public Cloud, les composants sont beaucoup plus flexibles puisque l’utilisateur a plus de contrôle sur le déploiement du cluster.

Architecture de Cloudera Private Cloud (fournie par Cloudera, Inc.)

- CDP PVC Base

- Cloudera Manager

- Hadoop

- Stockage, base de donnée

- Hive : logiciel de data warehouse (entrepôt de donnée) conçu pour permettre les requêtes et l’analyse des données

- HBase : base de données distribuée non relationnelle permettant de stocker des quantités massives de données éparses de manière tolérante aux pannes

- Kudu : moteur de stockage de données distribuées orienté colonne pour les données d’analyse rapide

- Streaming

- Kafka : plateforme de messages en steaming

- Stream Messaging Manager (SMM) : outil de gestion et de monitoring (supervision) des opérations offrant une visibilité de bout en bout dans un environnement Apache Kafka d’entreprise

- Stream Replication Manager (SRM) : une réplication de topics Kafka tolérante aux pannes, évolutive et robuste entre les cluster, au niveau de l’entreprise

- Requête

- UI

- Hue : SQL Assistant pour l’interrogation des bases de données et des data warahouses ainsi que pour la collaboration

- Zeppelin : une interface web permettant d’analyser et de mettre en forme facilement de grands volumes de données traitées avec Spark

- Data Analytics Studio (DAS) : application qui fournit des outils de diagnostic et des recommandations judicieuses pour aider les Business Analysts à devenir plus autonomes et productifs avec Hive

- Security, administration

- CDP PVC Plus

- OpenShift : déployer des projets dans des conteneurs

- Experiences

- Datawarehouse : la construction en libre-service de data warehouse et de datamarts autonomes qui augmentent ou diminuent automatiquement leur capacité en fonction de l’évolution de la charge de travail

- Machine Learning : Déploiement des espaces de travail de Machine Learning

- Cloudera Data Science Workbench (CDSW) : plateforme qui permet aux Data Scientists de gérer leurs propres pipelines d’analyse

- Cloudera Flow Management (CFM)

- NiFi : automatiser les mouvements de données entre différents systèmes

Avantages de CDP Private Cloud

- Fléxibilité — l’environnement cloud de votre organisation peut être adapté pour répondre à des exigences commerciales spécifiques.

- Contrôle — Des niveaux plus élevés de contrôle et de confidentialité grâce à des ressources non partagées.

- Scalabilité — les clouds privés offrent souvent une meilleure scalabilité, par rapport aux infrastructures on-premises.

Conclusion

Cloudera Data Platform (CDP) vous offre une grande polyvalence lorsqu’il s’agit de créer et de maintenir un data warehouse de production basé sur le cloud, ce qui facilite la migration des données vers le cloud et l’exécution de data warehouse en production. Ils dépendent tous deux de Shared Data Experience (SDX), qui est chargée de la sécurité et de la gouvernance. Globalement, il s’agit d’une solution adéquate pour les entreprises qui ont besoin d’un environnement cloud fiable, évolutif et sécurisé. Elle offre la possibilité de choisir entre le cloud privé et le cloud public, qui présentent tous deux leurs propres avantages.